facebook说它的算法对你的在线回音室不负责

2011年,进步活动家兼作家伊莱·帕里瑟(Eli Pariser)讲述了一个令人不安的故事,讲述了社交网络可能扭曲我们对世界的看法的方式他在一次TED演讲中说:“我总是不厌其烦地去见保守派。”所以有一天,当我发现保守党从我的Facebook上消失的时候,我很惊讶。结果是,Facebook关注的是我点击了哪些链接,它注意到,实际上,我点击的更多是自由派朋友的链接,而不是保守派朋友的链接。在没有咨询我的情况下,它就把它们删掉了。他们消失了。”

帕里瑟说的是他所谓的“过滤泡沫”,互联网公司创造的一个个性化的屏障,向我们展示更多我们已经喜欢的东西,而不是我们不喜欢的东西。Pariser泡沫有很多表现形式,包括定向广告和搜索结果(例如,谷歌根据你的网络历史调整了搜索结果)。但Facebook的新闻提要算法是最明显、最贴切的算法之一;一家公司,不管多么仁慈,都会间接地选择你能看到谁的意见。然而,在《科学》杂志上发表的一项研究中,Facebook认为,阻止你阅读相反观点的并不是你的反馈,而是你自己。

“人们的个人选择。。。比任何算法选择都重要。”

研究人员Eytan Bakshy说:“人们对于与谁互动以及选择什么的个人选择比任何一种算法选择都更重要。”。Bakshy和他的两位合著者是Facebook数据科学团队的成员(其中一位是Lada Adamic,也是密歇根大学的副教授)。在他们最新的研究中,他们使用了来自数百万Facebook用户的数据来研究决定某人是否看到、点击或分享一条可能与他们的政治观点不符的新闻的因素。

Bakshy和他的团队首先收集了来自1010万美国Facebook用户的匿名统计数据,这些用户的个人资料显示了他们的政治立场。从那里,他们研究了被归类为“硬新闻”(与娱乐或体育相反)的联系,并根据政治联盟对其进行分类——这种联系是否更多地被那些自称为自由派或保守派的人所分享。然后,他们检查了这些链接在观看过程中出现的频率。人们的朋友是否分享了意识形态上对立的内容?用户真的看到了吗?如果他们看到了,他们是不是在点击?

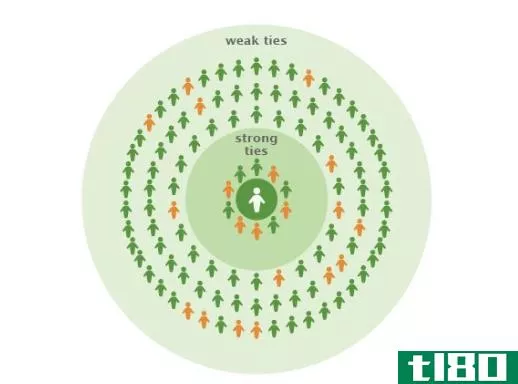

这项工作是在之前的一项发现之后进行的,虽然你可能会与几个亲密的朋友进行互动,但绝大多数信息来自于较弱的联系。当时,Bakshi说这表明“Facebook不是一些人可能期望的回声室”,因为这些薄弱的联系往往来自不同的社区——只要想想你从亲戚和高中朋友那里看到的东西。但是Facebook的新闻提要算法将紧密联系放在首位,这让你从过去喜欢、评论或分享(除其他事项外)的人那里向你展示更多。理论上,这可能会把用户困在一个回声室里,里面装满了他们已经同意的人。

少数相反的观点确实被排除在新闻提要之外

Bakshy说,在Facebook上被认为是自由派和保守派的人数大致相当,但他们的社交网络并不是同样的自由派和保守派;对于报告他们的归属关系的用户,平均有23%的朋友认同对方。总体而言,保守派更倾向于分享内容,但总体而言,研究发现,自由派朋友分享的新闻中,约有四分之一与保守派保持一致,保守派朋友分享的内容中,有三分之一是自由派的。”Bakshy说:“自由主义者倾向于较少接触保守主义者分享的内容,因为他们倾向于较少接触主要来自保守主义者的个人。”。

这里的测试是这些共享链接是否真的出现在用户的新闻提要中,或者Facebook是否真的删掉了这些链接。事实证明,Facebook确实编辑了其中的一部分。根据数据,如果你是一个自由主义者,保守主义者的文章比自由主义者少8%进入你的新闻提要。如果你是保守派,你看到自由派新闻的可能性要低5%。从绝对值来看,无论是自由派还是保守派,看到的来自对方的新闻都比Facebook不调整新闻源少1%左右。

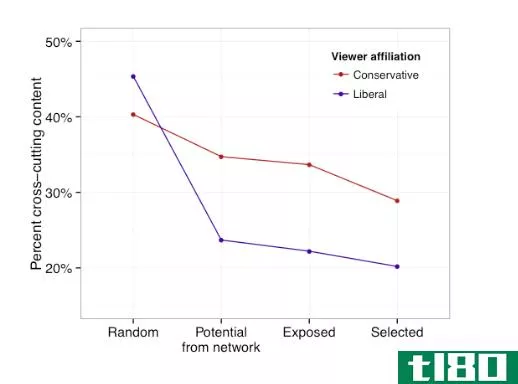

如果分享是完全随机的,自由主义者和保守主义者看到的反对链接的比例,与他们的朋友发布的内容和他们看到或点击的内容相比。

然而,这项研究发现,人们看到的东西和点击的东西之间的差距更大。自由党的朋友们所分享的东西中,大约有23%是保守派。他们在新闻提要中看到的内容有22%,而他们实际点击的内容有20%是保守的。对于保守派,他们的朋友分享34%的自由内容,他们看到33%,他们点击29%(根据这些数据,我们选择的回音室最终要比Facebook为我们选择的回音室大,无论是因为我们认识的人少,还是因为我们不太关注他们的分享。

帕里瑟在媒体上发表了自己对这项研究的回应,他称算法的效果“并非微不足道”,特别指出,对于自由主义者来说,算法的重要性只是略低于点击率。他还说,“过滤泡沫”还体现在人们共享什么样的内容上“人们在Facebook上点击的内容中只有7%是‘硬新闻’,”他说这是拼图中令人痛苦的一小部分。这也意味着‘软’新闻可能会赢得社交媒体的关注,至少目前是这样。”

由于这项研究只对那些有强烈政治倾向的人进行了测量,Bakshy认为这一数字为9%,因此他们很可能不代表Facebook的广大用户。”我们所知道的是,温和派和不自我报告的人非常相似,温和派在Facebook上的行为看起来就像保守派和自由派但这是一个有趣的问题。

“自由派和保守派都有可能接触到对方的内容。”

还有一些微妙之处是Facebook的自动分析无法看到的。例如,它无法判断你是否正在阅读一篇文章的摘要和标题,但没有点击。而且,由于政治结盟是基于一般平均数,因此它不是“旋转”甚至倾斜的衡量标准。”Bakshy说,有可能我们将事物归类为自由主义,但实际上它并不包含任何倾向或偏见,“例如,因为它来自一个主要由自由主义者阅读的来源。”《赫芬顿邮报》的一些文章是相当中立的,但也有一些是相当两极分化的,“最终,他希望更深入地研究**法或生殖权利等单一问题。但他也乐观地认为,即使政治两极分化,回声室也并非不可逾越。”自由主义者和保守主义者都有可能接触到来自另一方的内容,事实上他们确实会点击来自另一方的内容,”他说。

Facebook并不是更大的“过滤泡沫”甚至其他社交网络的好代理。它通常是基于多个朋友圈,他们通过完全不同的线下兴趣相互了解,而人们可能会加入Twitter这样的网络,专门与不认识的人交谈。这与离线世界相比也很难分辨。互联网是否帮助人们分享他们可能不在面对面的对话中的新闻?或者是让我们整理自己的经历,以符合自己的观点?

虽然这远远超出了Facebook的范围,但Bakshy认为Facebook可能会帮助我们开始研究它。”他说:“这是我们第一次真正能够测量人们能接触到多少来自另一方的信息。”在线下世界还没有办法衡量这一点,我们在网络世界第一次能够以非常精细的水平来衡量这一点。”

更新时间:5月7日,美国东部时间下午2:30:添加了Eli Pariser的评论。

- 发表于 2021-04-29 20:23

- 阅读 ( 204 )

- 分类:互联网

你可能感兴趣的文章

资料自拍:facebook到底对你了解多少?

你有没有想过Facebook对你了解多少?很明显,他们知道的越多,赚的钱就越多。但整个过程相当不透明——这让很多人感到紧张。 ...

- 发布于 2021-03-15 01:19

- 阅读 ( 157 )

facebook希望你解决它的假新闻问题

Facebook有一个假新闻问题需要解决。不幸的是,确定什么是真的,什么是假的,什么是观点,什么是讽刺是一项非常棘手的工作。难怪Facebook会求助于它的用户来帮助它解决这个问题。 ...

- 发布于 2021-03-16 15:39

- 阅读 ( 160 )

突破社交媒体回音室

...事上达成一致意见时,你更容易保持观点,而不是当你在Facebook和Twitter上关注的成百上千的人在说同一件事时。 ...

- 发布于 2021-03-16 16:05

- 阅读 ( 166 )

避免在网上和公共场合出现面部识别的4种方法

... 像Facebook这样的社交媒体网站有面部识别算法,可以分析上传到网站上的照片,为谁应该在照片上加标签提出建议。当有人在照片中标记你时,他们正在训练算法,以便更准...

- 发布于 2021-03-20 12:44

- 阅读 ( 231 )

什么是facebook reach?它对你有什么影响?

Facebook是世界上最大的社交网络。截至2018年第三季度,其月活跃用户数为22.7亿。从这个角度来看,这大约是世界总人口的三分之一。面对如此庞大的受众群,Facebook是互联世界的理想在线平台。 ...

- 发布于 2021-03-22 09:20

- 阅读 ( 222 )

facebook根据你的活动预测你的政治立场

可以公平地说,Facebook目前并不享受美好时光。这家公司在争议中步履蹒跚;从假新闻到影响选举,它都受到了抨击。 ...

- 发布于 2021-03-25 06:40

- 阅读 ( 158 )

获取机器学习项目数据集的4种独特方法

... 你也可以通过Facebook、LinkedIn、Instagram和Twitter等社交媒体收集数据。从社交媒体获取数据比其他任何方法都要技术化一些。它是完全自动化的,涉及到使用不同的API工具。 ...

- 发布于 2021-03-29 21:16

- 阅读 ( 230 )

所有的社交网络都应该让我们从算法中夺回控制权

...的观点,我完全同意。 While Instagram may not buck parent company Facebook’s love of algorithmic feeds, it should do exactly that (and Facebook should do it too!)—calm down the masses and give us a goddamn sparkle button. Stop trying to force side-scrolling feeds and other junk featur...

- 发布于 2021-04-04 01:10

- 阅读 ( 210 )

为什么facebook麦克风神话依然存在

我认识的很多人都确信Facebook正在监听他们的电话和当面交谈。称之为麦克风神话。但为什么这些神话在没有确凿证据的情况下依然存在? 人们对Facebook很偏执,但他们不知道该把这种偏执放在哪里。阴谋论是必然的结果。 相...

- 发布于 2021-04-06 10:21

- 阅读 ( 147 )