使用人工智能根据姓名来识别性别的服务看起来极为偏颇

一些科技公司一上市就大放异彩,而另一些公司则似乎大吃一惊。

Genderify是一项新的服务,它承诺在人工智能的帮助下,通过分析某人的姓名、电子邮件地址或用户名来识别其性别,它看起来肯定属于后者。该公司上周推出了产品搜索,但由于用户发现其算法存在偏差和不准确之处,在社交媒体上引起了大量关注。

例如,在Genderify中键入名称“Meghan Smith”,服务将提供评估:“**:39.60%,**:60.40%”。但是,将该名称更改为“Dr.Meghan Smith”,评估将更改为:“**:75.90%,**:24.10%。“其他以“Dr”为前缀的名字也会产生类似的结果,而输入似乎通常会偏向**。“[email protected]例如,据说有96.90%的人是**,而“琼·史密斯夫人”则有94.10%是**。

反对这项服务的呼声如此之高,以至于Genderify告诉《边缘报》,它将完全关闭。一位代表通过电子邮件说:“如果社区不想要,也许这是公平的。”。Genderify.com网站已脱机,其免费API不再可访问。

尽管这些偏见经常出现在机器学习系统中,性别化的轻率似乎让该领域的许多专家感到惊讶。研究人工智能对社会影响的AI Now研究所联合创始人梅雷迪思·惠塔克(Meredith Whittaker)的反应有些典型。“我们是不是被人跟踪了?”她问道。“这是一场心理战,意在分散科技+司法界的注意力吗?已经是愚人节了吗?”

问题不在于Genderify根据某人的名字对其性别进行假设。人们总是这样做,有时在这个过程中会犯错误。这就是为什么了解人们如何自我认同以及他们希望如何被称呼是礼貌的。性别验证的问题在于它自动化了这些假设;在将个体分为**/**二元(因此忽略了那些认为是非二元的个体)的同时,在这个过程中强化了性别刻板印象(例如:如果你是医生,你可能是个男人)。

这种做法的潜在危害取决于性别歧视的应用方式和地点。例如,如果将该服务集成到医疗聊天机器人中,它对用户性别的假设可能会导致聊天机器人发布误导性的医疗建议。

谢天谢地,Genderify的目标似乎并不是让这类系统自动化,而是主要设计成一种营销工具。正如Genderify的创始人Arevik Gasparyan在产品搜索上所说:“Genderify可以获得数据,帮助你进行分析,增强你的客户数据,细分你的营销数据库,人口统计等。”

在同一评论部分,Gasparyan承认了一些用户对偏见和忽视非二元个体的担忧,但没有给出任何具体的答案。

一位用户问:“假设我选择既不是**也不是**,你是怎么做的?如何避免性别歧视?你是如何处理性别偏见的?对此,Gasparyan回答说,该服务基于“已经存在的二进制名称/性别数据库,该公司正在“积极寻找改善变性人和非二元访客体验的方法”,将姓名/用户名/电子邮件的概念与性别身份区分开来。这是一个令人困惑的答案,因为性别鉴定的整个前提是这些数据是性别身份的可靠代表。

该公司告诉《边缘报》说,这项服务与现有公司非常相似,后者使用姓名数据库猜测个人性别,不过没有一家公司使用人工智能。

一位代表通过电子邮件表示:“我们明白,我们的模型永远不会提供理想的结果,算法也需要大幅改进,但我们的目标是建立一个自学习的人工智能,不会像任何现有解决方案那样有偏见。”。“为了让它发挥作用,我们非常依赖变性人和非二进制访问者的反馈,帮助我们尽可能地为LGBTQ+社区改进性别检测算法。”

更新时间:美国东部时间7月29日星期三下午12:42:报道已经更新,以确认Genderify已经关闭,并添加了该公司代表的补充意见。

- 发表于 2021-04-18 16:45

- 阅读 ( 159 )

- 分类:互联网

你可能感兴趣的文章

医学的未来:应用程序能诊断健康问题吗?

... 那么,如果你能在人工智能的帮助下诊断出你的疾病而不去看医生或医院呢?有了HealthTap的A.I.医生,这实际上是可能的。 ...

- 发布于 2021-03-14 09:11

- 阅读 ( 154 )

什么是机器学习算法?他们是这样工作的

人工智能和机器学习产生了我们今天在技术工业中看到的许多进步。但是机器是如何被赋予学习能力的呢?此外,我们这样做的方式是如何导致意想不到的后果的? ...

- 发布于 2021-03-23 07:51

- 阅读 ( 172 )

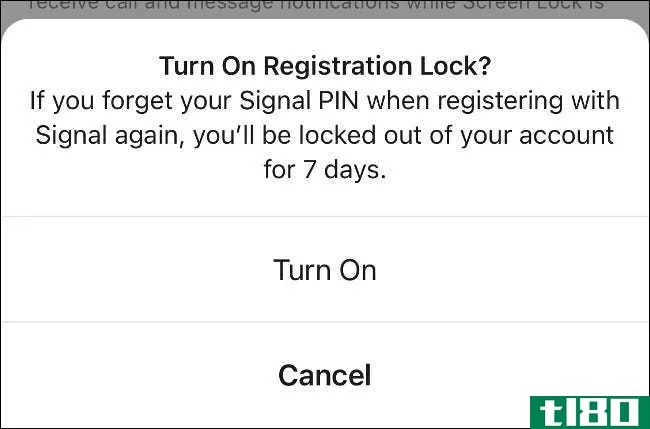

如何使您的信号聊天尽可能安全

...以去。 但如果有人能查到你的电话号码怎么办?虽然这看起来不太可能发生,但也在可能的范围之内。有人可能会盗取你的智能**SIM卡,或者利用社会工程技术欺骗你的**服务提供商将你的号码转移到新的SIM卡上。 通过访问你的...

- 发布于 2021-03-31 16:22

- 阅读 ( 249 )

谷歌人工智能工具将不再在人们的照片中使用“女人”或“男人”这样的性别标签

谷歌为开发者提供的人工智能工具’不要再在图片上添加性别标签了,比如说一个人’s性别可以’据《商业内幕》报道,这并不能仅仅由照片中的表情来决定。 该公司今天向开发人员发送了一封电子邮件,告知其广...

- 发布于 2021-04-20 06:05

- 阅读 ( 159 )

人工智能在学习人类书写的东西时会发现种族和性别偏见

研究人员说,人工智能在从文本中学习语言时会发现种族和性别偏见。在没有任何监督的情况下,机器学习算法学会了将**名字与家庭词汇相关联,而不是与职业词汇相关联,将黑人名字与白人名字相关联。 在今天发...

- 发布于 2021-05-10 17:27

- 阅读 ( 224 )

小米6将尝试猜测你的性别和年龄

...包括一个800万像素的前置摄像头,带有自动美化过滤器和人工智能,可以猜出你的性别和年龄。为什么会这样?我不知道。 我本周测试了这个特性,结果发现它不太好用。令人震惊。我26岁了,但摄像机以为我有24岁...

- 发布于 2021-05-11 12:15

- 阅读 ( 91 )

在创建新的在线帐户时假装生日

...你最喜欢的新论坛你的电话号码吗?可能不会,除非他们使用的是两步认证(即便如此,为什么不改为谷歌语音号码?)巴斯金·罗宾斯真的需要你的地址吗?如果你想要一张优惠券,当然可以,但我想他们会处理得很好。每个人...

- 发布于 2021-05-12 16:37

- 阅读 ( 113 )

是什么让人工智能具有种族歧视和性别歧视

人工智能正渗透到我们的日常生活中,应用程序可以管理你的**图片、管理你的电子邮件,以及将任何语言的文本翻译成另一种语言。谷歌、Facebook、苹果和微软都在大力研究如何将人工智能集成到它们的主要服务中。很快你就...

- 发布于 2021-05-15 20:43

- 阅读 ( 153 )

mozilla正在众包语音识别,让人工智能为人们服务

数据对于构建伟大的人工智能至关重要,以至于该领域的研究人员将其与工业革命时期的煤炭进行了比较。那些拥有它的人会向前冲。不这样做的人会被扔在尘土里。在当前的人工智能热潮中,谁拥有它是显而易见的:像谷歌、...

- 发布于 2021-05-29 05:04

- 阅读 ( 108 )

什么是语音识别的应用?(the applications of speech recognition?)

...可能的发展领域包括在电话系统、计算机文本对话程序和人工智能(AI)应用开发中的应用。在电话系统和各种电话应用中,语音识别允许通过自动化系统比通过按键应用更容易地处理菜单和呼叫路由。计算机程序可以利用“对...

- 发布于 2021-12-08 13:01

- 阅读 ( 125 )