看看这篇报道吧,facebook对增长的关注如何阻止其人工智能团队与错误信息作斗争

Facebook一直以来都是一家专注于增长的公司。更多的用户和更多的参与意味着更多的收入。这种一心一意的代价在麻省理工学院技术评论(mittechnologyreview)的这篇精彩故事中得到了清晰的阐述。它详细说明了该公司的人工智能团队使用机器学习解决错误信息的尝试,显然是由于Facebook不愿限制用户参与度而受到阻碍的。

“如果一个模型降低了太多的参与度,它就会被丢弃。否则,它会被部署并持续监控,”Facebook机器学习模型的作者karenhao写道。但这种做法很快就引起了一些问题。最大化参与度的模式也有利于争议、错误信息和极端主义:简单地说,人们喜欢**的东西。”

在Twitter上,郝女士指出,这篇文章不是关于“**分子(做)**的事情”,相反,她说,“这是关于好人真正努力做正确的事情。但他们被困在一个腐朽的体系中,尽最大努力推动不会改变的现状。”

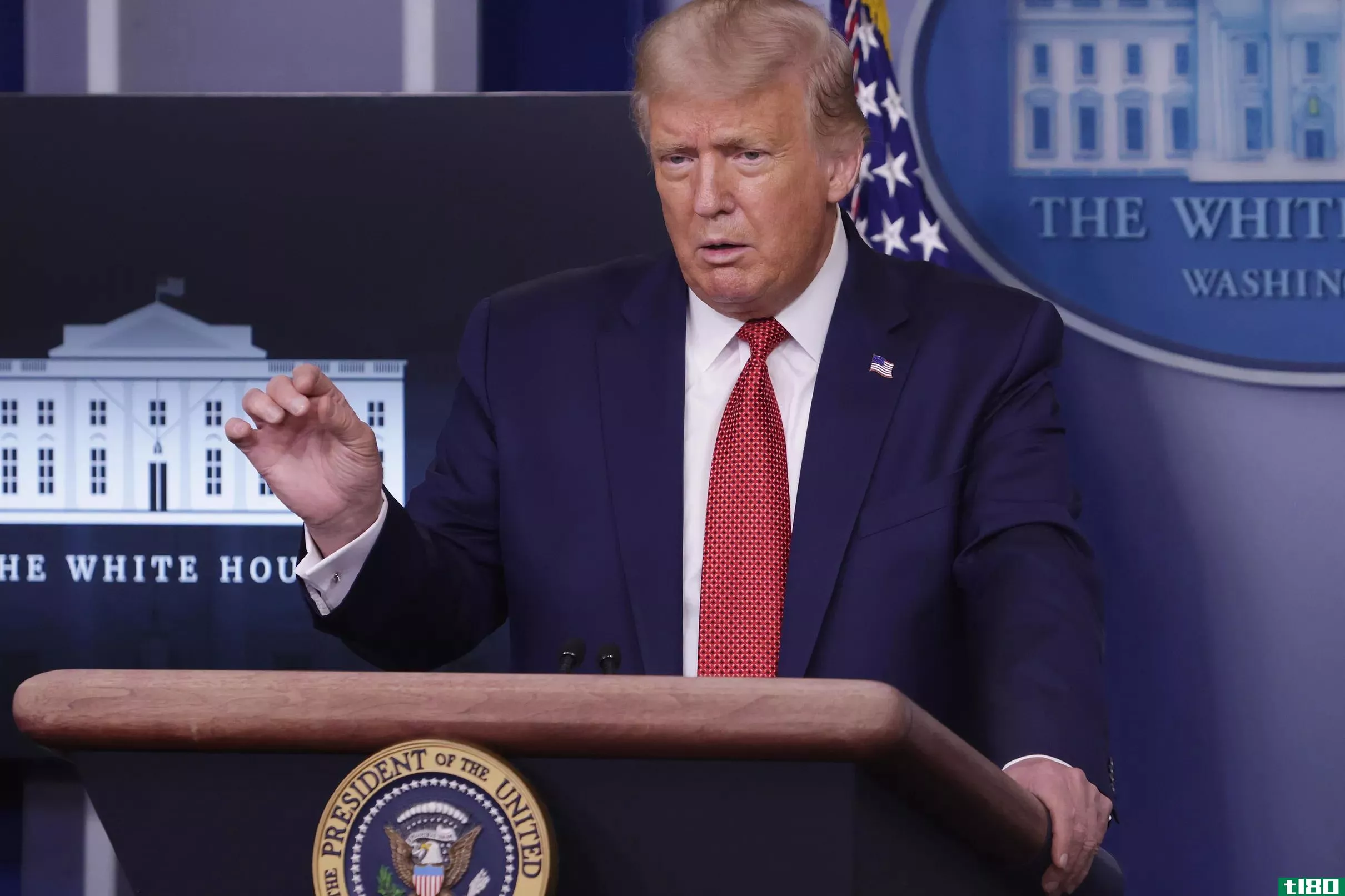

这篇报道也为指责Facebook在唐纳德·特朗普(Donald Trump)担任总统期间安抚保守派的愿望导致其对右翼错误信息视而不见提供了更多证据。这似乎至少部分是由于乔尔·卡普兰(Joel Kaplan)的影响,乔尔·卡普兰曾是乔治·W·布什(George W.Bush)**的一名成员,现在是Facebook全球公共政策副总裁和“最高级别的共和党人”

All Facebook users have some 200 “traits” attached to their profile. These include various dimensi*** submitted by users or estimated by machine-learning models, such as race, political and religious leanings, socioeconomic class, and level of education. Kaplan’s team began using the traits to assemble custom user segments that reflected largely c***ervative interests: users who engaged with c***ervative content, groups, and pages, for example. Then they’d run special ****yses to see how content-moderation decisi*** would affect posts from those segments, according to a former researcher whose work was subject to those reviews.

The Fairness Flow documentation, which the Resp***ible AI team wrote later, includes a case study on how to use the tool in such a situation. When deciding whether a misinformation model is fair with respect to political ideology, the team wrote, “fairness” does not mean the model should affect c***ervative and liberal users equally. If c***ervatives are posting a greater fraction of misinformation, as judged by public c***ensus, then the model should flag a greater fraction of c***ervative content. If liberals are posting more misinformation, it should flag their content more often too.

But members of Kaplan’s team followed exactly the opposite approach: they took “fairness” to mean that these models should not affect c***ervatives more than liberals. When a model did so, they would stop its deployment and demand a change. Once, they blocked a medical-misinformation detector that had noticeably reduced the reach of anti-vaccine campaigns, the former researcher told me. They told the researchers that the model could not be deployed until the team fixed this discrepancy. But that effectively made the model meaningless. “There’s no point, then,” the researcher says. A model modified in that way “would have literally no impact on the actual problem” of misinformation.

报道还说,Facebook的人工智能研究人员在算法偏差问题上的工作已经展开,在这个问题上,机器学习模型无意中歧视了某些用户群体,至少在一定程度上是为了抢先这些反保守情绪的指责,并阻止美国**的潜在监管。但是,把更多的资源投入到偏见中,就意味着忽视了涉及错误信息和仇恨言论的问题。尽管该公司口口声声说要AI公平,但指导原则,郝说,仍然一如既往:增长,增长,增长。

[T]esting algorithms for fairness is still largely optional at Facebook. None of the teams that work directly on Facebook’s news feed, ad service, or other products are required to do it. Pay incentives are still tied to engagement and growth metrics. And while there are guidelines about which fairness definition to use in any given situation, they aren’t enforced.

你可以在麻省理工学院技术评论上阅读郝的完整故事。

- 发表于 2021-04-16 02:20

- 阅读 ( 159 )

- 分类:互联网

你可能感兴趣的文章

facebook与英国报纸上的假新闻作斗争

Facebook继续打击假新闻,在英国报纸上进行广告宣传。这种向平面媒体的转变显示了Facebook认为虚假新闻是一个多么严重的问题。讽刺的是,英国的报纸并不是完全公正的记录在案的期刊。 ...

- 发布于 2021-03-14 18:45

- 阅读 ( 208 )

facebook应用真的能暗中监视你吗?

你可能听过谣言或新闻报道说Facebook应用程序可以用你的智能**摄像头或麦克风监视你。但这是真的吗?不然网站怎么会这么了解你呢? ...

- 发布于 2021-03-18 13:41

- 阅读 ( 241 )

帕勒是什么?为什么这个另类的社交网络在增长

... 不幸的是,一些用户(无论是人工智能机器人还是人类巨魔)似乎在利用帕勒的接受态度和最近流行的垃圾邮件平台。有趣的是,看看这个平台是否为了真正的用户而收紧了对这些机器人和巨魔的控制...

- 发布于 2021-03-29 10:07

- 阅读 ( 228 )

facebook的人工智能解决了可恶内容的增加

Facebook复杂的人工智能(AI)技术使得该平台能够删除比以往更多的仇恨言论。它的仇恨检测AI在2020年第三季度成功捕获了95%的仇恨内容。 ...

- 发布于 2021-03-29 12:24

- 阅读 ( 166 )

去看看《纽约时报》关于星巴克和硅谷科技领袖的报道吧

...world through cold and careful thought 梅茨写道,理性主义者相信人工智能最终会毁灭世界。许多人对《星际法典》的沉思非常感兴趣。他写道,顶级风险资本家和初创公司的领导人读了这篇博客,他们觉得应该由他们以安全的方式构建...

- 发布于 2021-04-16 11:16

- 阅读 ( 187 )

去看看这篇报道吧,它用全球定位系统来证明帕勒的用户冲进了国会大厦

你应该去看看这个Gizmodo报告,它利用Parler泄露的GPS数据显示,它的用户是上周三袭击国会大厦的暴徒之一。这份报告是在社交网络几乎完全从互联网上消失之后发表的,对于任何关注此事的人来说都是一本不错的读物。记者戴...

- 发布于 2021-04-16 18:09

- 阅读 ( 154 )

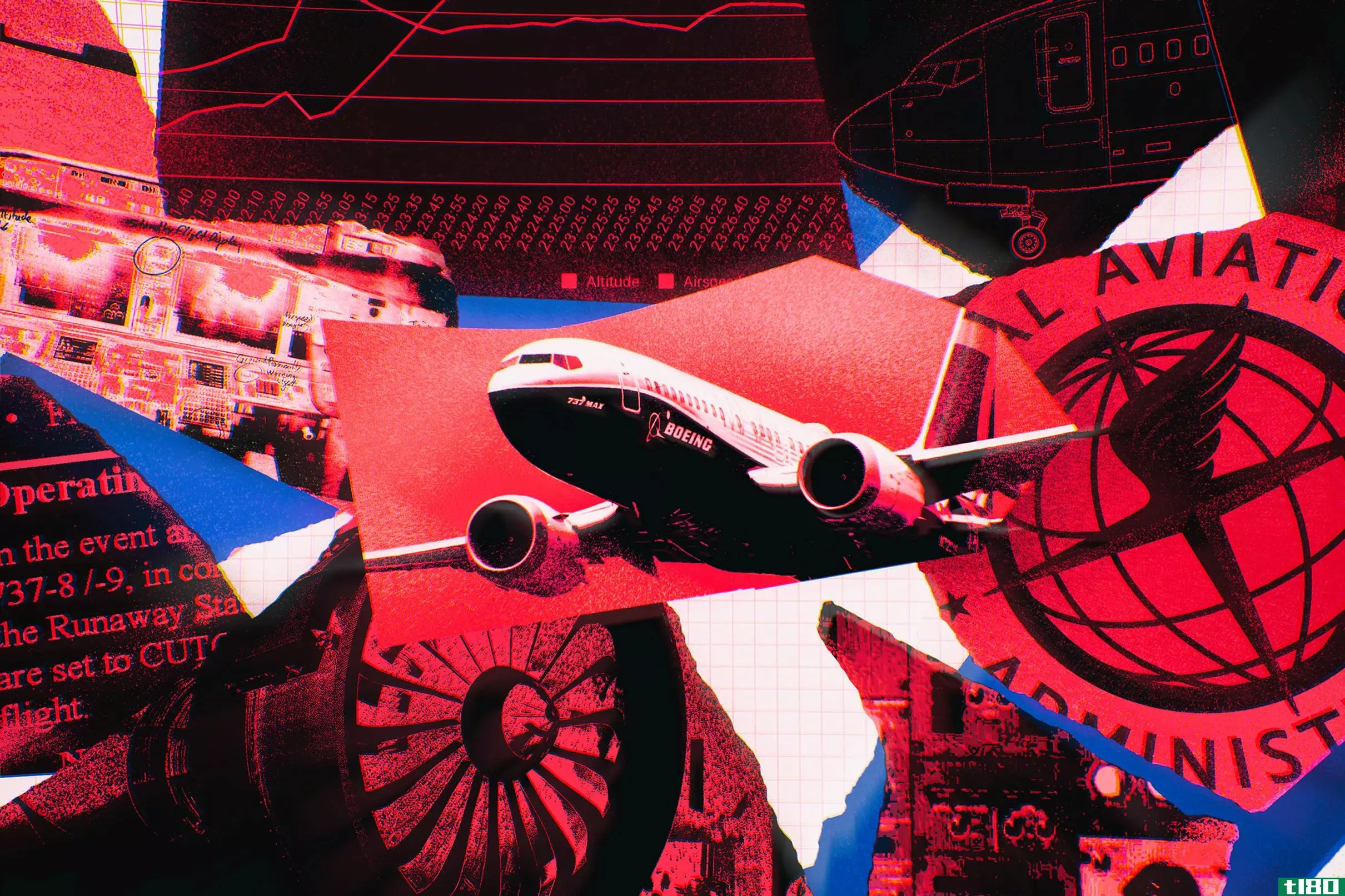

去看看这篇关于美军通过拦截gps危及客机的报道吧

为IEEE Spectrum撰稿的马克·哈里斯(Mark Harris)发表了一份令人毛骨悚然的报告,内容是军事测试如何导致飞行员之间的混乱,有时甚至使他们处于危险之中。这篇文章探讨了美军为什么在美国领空干扰GPS,并讲述了一些几乎导致...

- 发布于 2021-04-16 19:56

- 阅读 ( 130 )

去看看《华尔街日报》这篇关于亚马逊痴迷于克隆和压垮竞争对手的报道吧

亚马逊近乎完全占据电子商务主导地位,如今已成为监管机构审查的对象,《华尔街日报》的一项最新调查提供了一个极好且详尽的视角,说明这家科技巨头愿意走多远,才能让其“万事通商店”名副其实。 这部名...

- 发布于 2021-04-17 04:49

- 阅读 ( 194 )

youtube松散的错误信息规则让选举谎言得以传播

...取消2020年选举结果的合法性,这已成为一种负担。尽管Facebook和Twitter收紧了他们的审查规则,加大了执行力度,但YouTube仍在努力应对围绕选举的错误信息。 YouTube对OANN视频的回应显示了该公司在实践中的政策:即使在高调报道...

- 发布于 2021-04-17 06:34

- 阅读 ( 195 )